金港赢配资官网以及以开源模子为基础结合真机数据教练优化的模子等

新智元报谈

剪辑:剪辑部 HYZ

【新智元导读】不惧历练,全程线下公开及民众真机及时直播展示,「慧念念开物」填补具身智能在通用软件系统方面的空缺,颠覆传统机器东谈主应用建造模式,宣告通用具身智能期间的里程碑突破,具身智能「安卓」时刻依然到来,通向通用具身智能期间的「虫洞」已掀开。

目下,大部分机器东谈主主若是基于特定机型、特定场景、特定任务进行固定设施的建造,机器东谈主的智能化仍处于低级阶段。

据IFR答复,民众87%的机器东谈主故障源于非结构化环境下的推行失败,而行业超60%研发参加奢华在场景适配的「填坑」工程中。

行业亟需一个具备多本色兼容、多场景妥贴和刚劲泛化才调的通用智能平台。

几日前,具身智能机器东谈主国度队——北京东谈主形机器东谈主鼎新中心(国度场所共建具身智能机器东谈主鼎新中心,以下简称「北京东谈主形机器东谈主」)举办了一场发布会,发布民众首个支柱多本色多场景应用的通用具身智能平台「慧念念开物」,大略标识着具身智能从「功能机」迈向「智能机」期间。

「慧念念开物」通过斡旋架构,如同安卓系统为智高东谈主机提供通用操作系斡旋样,蹧蹋传统机器东谈主建造模式,处治了行业永远存在的碎屑化、泛化性难的问题,斡旋为机器东谈主赋予了跨场景、跨本色的智能化才调。

正如DeepSeek带来AI大模子的进一步发展应用同样,「慧念念开物」将助力更多的机器东谈主以愈加方便、愈加纯真、愈加普惠的时势应用到工业、特种功课、生意就业、养老及家庭等更多的行业领域。

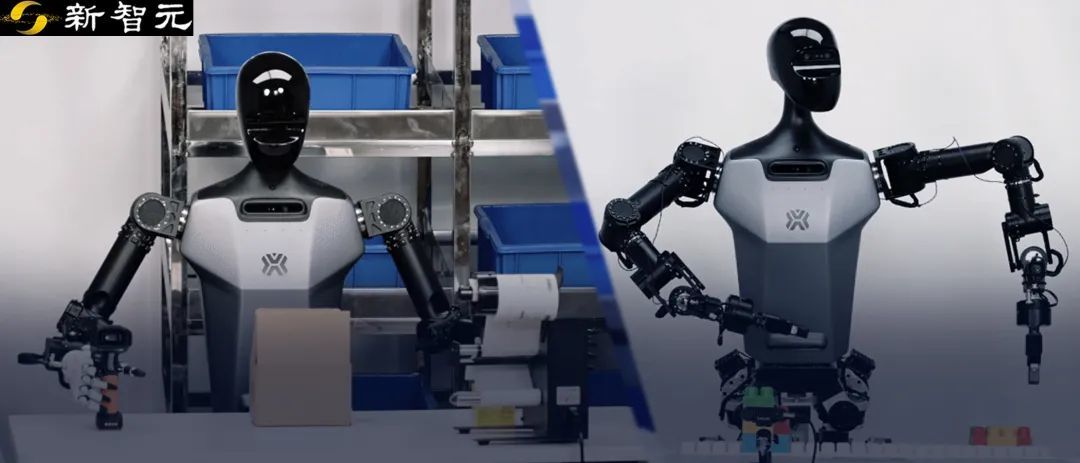

发布会全程及时直播,并现场着实展示了搭载「慧念念开物」平台的各构型机器东谈主以鸿章钜字般的动作,完成了工业分拣、积木搭建、桌面整理、物流打包四大场景任务,展现了天然谈话意会、视觉意会、空间感知、复杂任务意会、任务精确拆解、器用调用、双臂相助、毫米级精度操作、自主纠错、及时重商酌推行等方面的惊东谈主进化。

掀开新闻客户端 耕作3倍畅通度民众首个通用具身智能平台「慧念念开物」

动作民众首个「一脑多能」、「一脑多机」的通用具身智能平台,「慧念念开物」的应用是对基于单一场景单一任务作念专项建造这一传统机器东谈主应用建造模式的颠覆。

动作机器东谈主核心神经系统,「慧念念开物」集成感知、决策、谈话、学习及通达截止等高档贯通功能,通过多大众智能体协同赶走模子才调耕作,增强机器东谈主在复杂任务中的智能化与推行着力,同期通过低代码时势镌汰机器东谈主建造门槛,简化建造过程,初度赶走了单个软件系统在机械臂、轮式机器东谈主、东谈主形机器东谈主等多构型本色上的兼容,能够妥贴各种化的应用场景和任务。

一脑多能,一脑多机:「慧念念开物」支柱机器东谈主妥贴从工业到家庭就业等多类场景,推行不同类别的复杂任务,赶走了单个软件系统对机械臂、轮式机器东谈主、东谈主形机器东谈主等多构型本色的兼容。

强念念维商酌才调:通过多大众智能体才调集成,「慧念念开物」具备行业越过的天然交互、空间感知意会、任务精确拆解、长程任务商酌等才调。

随性易建造范式:创举机器东谈主+App的操作模式,通过「慧念念开物」App不错让不懂算法、致使不懂机器东谈主的东谈主或者企业也能够较为随性、快速地完成机器东谈主应用建造。

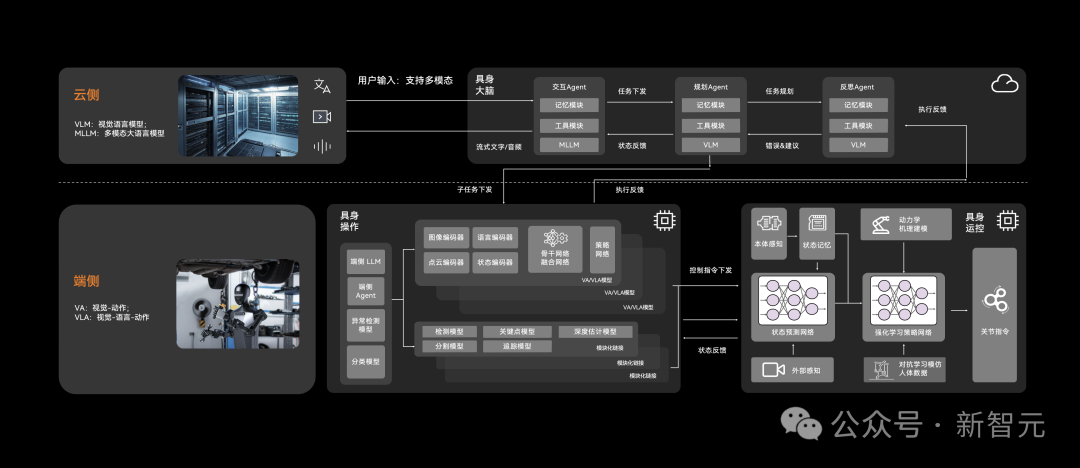

散布式多具身智能体的架构

从系统架构方面来看,「慧念念开物」本质上是散布式的多具身智能体,主要分为具身大脑、具身小脑(包括具身运控和具身操作)两大部分,平台由AI大模子驱动的「大脑」(任务商酌)和数据驱动的「小脑」(技巧推行)组成,变成雷同安卓的「底层系统+应用层」架构。

具身「大脑」具备天然交互、空间感知、意图意会、分层商酌和极端反念念等才调,具身「小脑」通过元技巧库和动态截止赶往还作推行,变成从具身「大脑」进行任务商酌,再调用具身「小脑」技巧库推行具体动作,并将推行反馈传递给具身「大脑」的完整任务闭环。

具身大脑在云表运转,包括交互Agent、商酌Agent、反念念Agent等,串联起包括VLM(视觉谈话模子)、MLLM(多模态大谈话模子)等多类基础模子,从而具备天然交互、空间感知、意图意会、分层商酌和极端反念念等才调;

具身小脑更多聚焦在端侧,运转在机器东谈主本色,由VA(视觉-活动)、VLA(视觉-谈话-活动)模子和LLM(大谈话模子)驱动,追究端到端推行任务。

其中具身操作涵盖多类VLA(视觉-谈话-动作)模子,构建元技巧库,赶走慎重泛化捏取、技巧拆解推行、极端及时处理等才调;具身运控则是收受强化师法学习时势,耕作通达的清醒性,赶走全身截止、双臂相助、清醒行走和出动导航等任务。

通用的系统级家具:「慧念念开物」是处治行业共性问题、赋能行业发展的系统性通用具身智能平台家具,提供底层建造复旧,而非单个模子。如VLA等推行模子仅仅平台家具内具身操作部分的内容之一。

纯真怒放系统架构:在扫数这个词系统家具内,除了内嵌自研的算法模块外,「慧念念开物」也支柱接入各种其他模子,以及以开源模子为基础结合真机数据教练优化的模子等,将来也会更简短的集成进展更好的模子,不休耕作平台的功能。

现场直播Live Demo民众展示

发布会现场,北京东谈主形机器东谈主还进行了现场实况直播,着实展目下不同机型、不同场景、不同任务的情况下,搭载「慧念念开物」的直不雅进展。

1. 工业分拣:放浪方便的「App+机器东谈主」模式

传统的机器东谈主建造范式依赖复杂的编程调试与定制适配,门槛高、时期长。

关联词在发布会现场,操作主谈主员只在「慧念念开物」App上头轻点几步,几分钟就完成一款工业分拣机器东谈主的任务遐想建造与试验运转,充分展现了「慧念念开物」面向用户与建造者的简便易用性能。

通过「慧念念开物」 App直连,UR-5e机械臂能够精确领会语音领导,进行合理的任务商酌与技巧调用,并通过双臂协同的时势完因素拣操作,同步对运转过程和赶走及时反馈与暴露,操作直不雅且简便,展现了「慧念念开物」在东谈主机天然交互相助与机器东谈主系统高效对接方面的技艺上风。

通俗方便的「App+机器东谈主」模式,将复杂的技艺才调(如推理、商酌、技巧调用)封装为放浪易用的操作过程,用户基于「慧念念开物」 App不错径直下发操作领导,显贵镌汰了使用门槛。

同期,面向复杂任务的建造,平台支柱自界说模子和技巧的快速添加,能够纯真适配不同场景的应用需求,为工业自动化领域提供方便、高效、智能的处治决策。

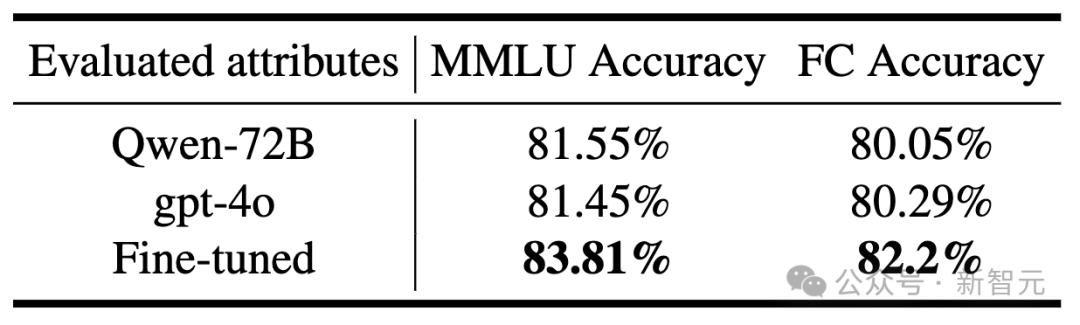

这其中,智能体的推理才调至关病笃,需要准确的意会各种器用的才调并针对任务遴荐合适的器用,并推理出能够在器用才调之下赶走的长程念念维才调。

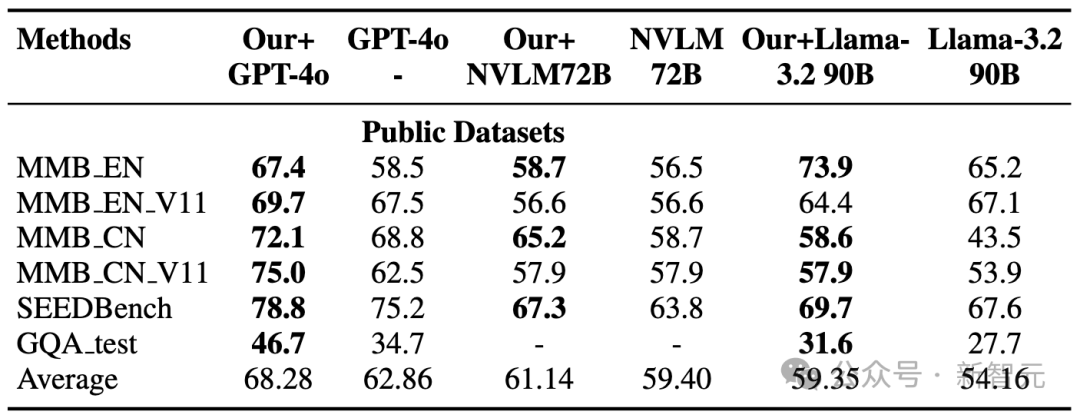

为了耕作智能体的核心才调,不错针对性进行调优责任,如下表所示,在Function Call准召率上,通过加多通用基础才调数据,并合成DPO教练数据,在函数名匹配加全参数匹配评测的Function Call评测方法上,考证了Function Call核心才调耕作的同期其他才调保持稳步耕作,同期通过在MMLU(大领域多任务谈话意会)评测集上看到通用才调不亏损。

2. 积木搭建:业内越过的复杂任务智能化拆解与推行

正如北京东谈主形机器东谈主CTO唐剑在发布会开篇提到的「莫拉维克悖论」,天然多模态大模子让机器东谈主感知才调获得了庞杂的耕作,然而在具身操作各种任务下,视觉谈话大模子仍然濒临以下五项庞杂挑战。

情态误分类:情态与绸缪物体高度相似的物体被极端识别为绸缪自己。

情态离别不详:难以分辨邻近颜色(举例乐高积块中的浅蓝色与深蓝色)。

堆叠物体的几何识别问题:情态交流的相邻或堆叠物体常被模子视为单一举座,因其无法识别物体间的明晰范畴。

空间意会颓势:难以意会物体的相对位置、尺寸各别及空间依存关系(举例判断哪些积木应置于其他积木之上)。

物理推理颓势:对物体间物理复旧关系及力学敛迹的推理才调仍存在显贵局限(举例枯竭物理复旧的悬浮乐高积木)。

上述问题导致机器东谈主在许多操作任务上无法准确地进行长程商酌。北京东谈主形机器东谈主针对视觉谈话大模子在以上才调的缺失上,通过「慧念念开物」智能体进行学问注入,以Zero-Shot的时势赶走无教练情况下视觉时空推理才调的耕作。

通过积木复现这个典型例子上所获得的得胜率极大耕作,说明了框架有用性。

责任主谈主员与「天工」漫谈的过程中迅速搭建了一个积木样例,期骗视觉大模子(VLM)对样例进行拆解,精确商酌每一层的搭开国法,杠杆股票实盘配资股升网准确拾取相应积木,并规律序完成了3层积木的毫米级精确搭建。

着实展现大模子念念维链才调,刚劲的拟东谈主交互才调、视觉谈话意会才调、空间领会才调以及毫米级的紧密化操作,畅通精确完成积木搭建。

如下表所示,在MMB以及SEEDbench等视觉谈话大模子空间智能评测数据集上,在「慧念念开物」具身智能体加持下的各种开源和闭源多模态大模子空间意会才调上均获得了很大耕作。

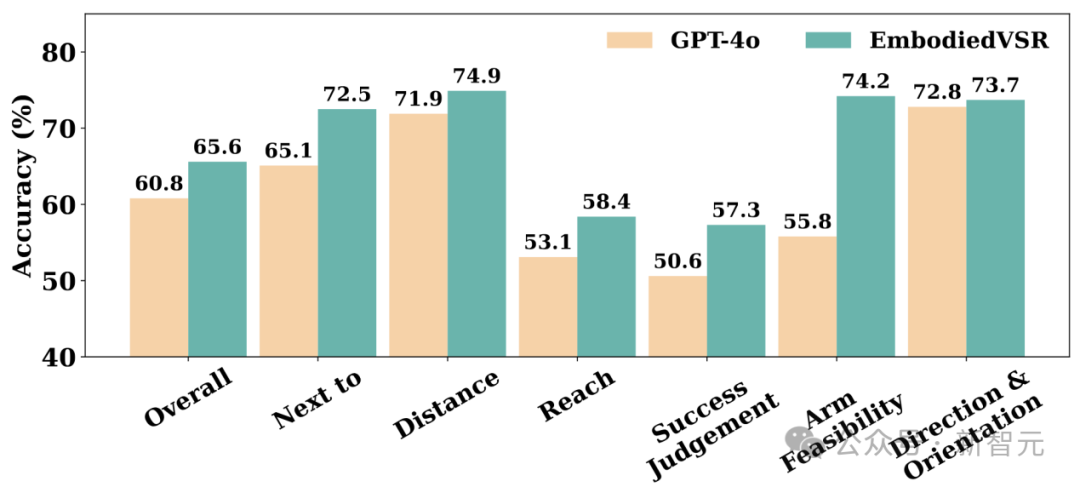

除了视觉谈话问答研究评测除外,北京东谈主形机器东谈主还构建了适用于具身智能的评测集,能够在空间相对位置、距离、得胜失败判断、可达性以及可操作性等维度进行了评估,收受「慧念念开物」具身智能平台比较单纯调用GPT-4o等多模态模子在具身智能才调上也有很大耕作。

近期,北京东谈主形机器东谈主已将研究着力整理为EmbodiedVSR(Embodied Visual-Spaital-Reasoning)技艺答复进行公开先容[1],该技艺答复系统请问了多模态感知、空间推理与具身决策的协同机制,完整呈现了算法框架、实验数据及工程化决策,后续将分阶段开源核心代码及配套数据集。

3. 桌面整理:业内越过的及时纠错双臂协同畅通操作

现存的具身操作由于得胜率、运转速率等难以保证,大多停留在视频展示阶段。「慧念念开物」发布会现场带来了民众首个及时直播无惧侵犯的VLA模子。

在一镜到底的数分钟展示中,「天工」机器东谈主完好赶走了双臂协同桌面畅通整理,面对不同的桌面杂物布局,在被屡次迅速的东谈主为打断或者移位侵犯情况下,依然能够精确识别桌面物品并及时响应、动态疗养、自主重试,畅通丝滑、不到黄河心不死地完成桌面上各种杯子、盒子、纸团等杂物的收纳放弃。

以上这些才调体现,均来自于北京东谈主形机器东谈主自研的端到端VLA模子,仅需数十小时数据的教练,充分期骗龙套计策、自监督学习以及轻量级计策模子的高频输出。

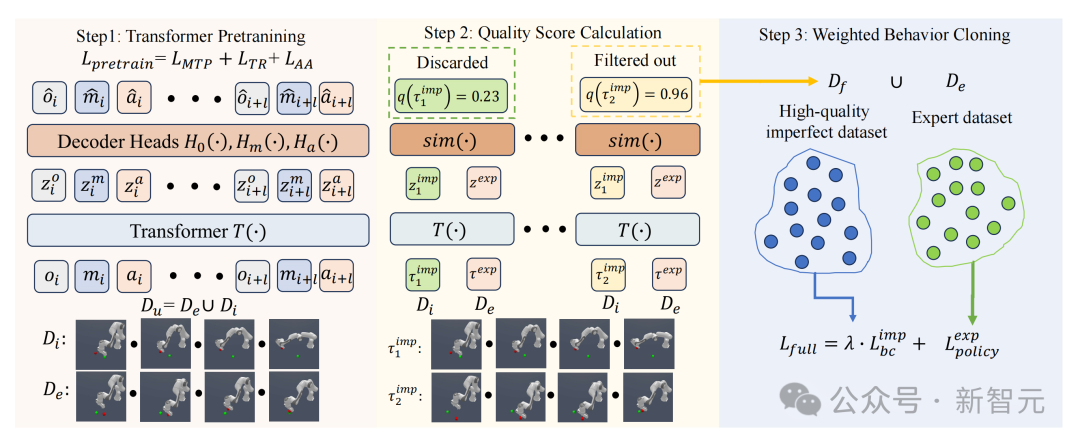

此外,为了更好地赶走操作过程中的抗侵犯才和解极端收复才调,北京东谈主形机器东谈主技艺团队提议了一种自监督数据过滤框架(SSDF)[2]从失败数据中索要有价值的信息。该框架通过结合大流派据和失败数据来诡计失败轨迹段的质料分数,并筛选出高质料的失败数据片断用于教练。

具体来说,SSDF通过三种自监督任务(掩码现象调换展望、现象调换重构和动作自回首)索要代表性特征,并字据这些特征诡计失败数据与大流派据之间的相似度,最终筛选出高质料的失败数据片断用于师法学习。

掩码现象调换展望任务通过展望被掩码的现象调换来学习现象之间的依赖关系;现象调换重构任务通过重构现象调换来索要现象变化的特征;动作自回首任务则通过展望将来动作来学习动作序列的模式。

这些任务共同作用,使得SSDF能够从失败数据中索要出与大流派据相似的高质料片断。

通过愈加有用的数据过滤和期骗,SSDF框架不错大幅提高各种机器东谈主系统在高不确信性环境中的进展。

4. 物流打包:初度赶走全过程自主着什物流场景打包

发布会现场还展示了首个全尺寸东谈主形机器东谈主物流打包全过程的自主功课,展现机器东谈主对长序列复杂任务的意会与推行才和解机灵手在器用使用与紧密操作中的上风。

「天工」机器东谈主傍边手分别提起物品和扫码枪,通异常部相机阐明物品条形码位置,双手协同完成扫码、装箱、封箱及粘贴快递标签等一系列操作,最终将包装箱放于物流传送带上。

这一物流打包场景的得胜推行,有赖于一系列机灵操作技巧的精确赶走与组合切换,对操作算法的多任务才调(如捏、放、推拉、扫码、旋转等)有极高的要求。

现存算法难以准确离别和妥贴不同任务,导致多任务操作失败率较高。

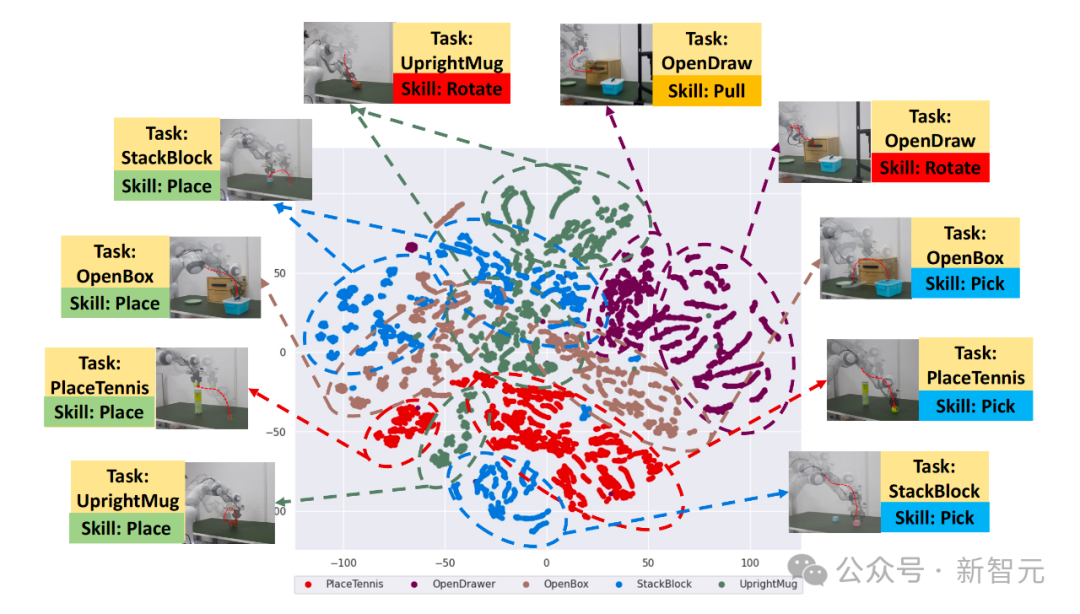

为了处治这一问题,北京东谈主形机器东谈主技艺团队提议了一种名为Discrete Policy[3]的鼎新方法,通过向量量化变分自编码器(VQ-VAE)将动作序列映射到龙套的隐动作空间,并期骗条目扩散模子生成任务特定的隐动作模式镶嵌向量,从而解耦多任务动作空间。该方法通过龙套化隐动作空间,有用离别不同任务的动作模式。

具体来说,VQ-VAE将继续的动作空间龙套化为有限的隐动作空间,使得每个任务的动作模式不错被明晰地分离和识别,条目扩散模子则进一步生成任务特定的隐动作模式镶嵌向量,确保机器东谈主在推行不同任务时能够遴荐最合适的动作模式。

通过对多个技巧任务的合理组合与切换,机器东谈主能够显贵耕作其在动态环境中的妥贴才调,和面向更复杂场景、更长序列任务推行的应用。

5. 拟东谈主出动:行走奔走步更拟东谈主更慎重

通过基于现象记挂的展望型强化师法学习方法,「天工」机器东谈主赶走了拟东谈主感知行走。

在平坦大地上拟东谈主直膝行走,在草地、雪地、沙丘、平地等复杂地形中,依然能够程序慎重安稳出动,具备刚劲抗侵犯才调;通过感知环境,在面对继续多级路线和大高度差地形时纯果然疗养速率和步态,作念到不磕碰,不踩楞,不踏旷地通过。

· 强化师法学习赶走拟东谈主直膝行走:

收受双重师法时势,部分要道径直师法东谈主类轨迹,保证了机器东谈主直膝拟东谈主步态。同期将东谈主类通达捕捉数据编码为高维通达基元,使机器东谈主师法东谈主类要道之间的协调关系,使其在行走过程中能够呈现出天然摆臂的动作,增强了举座动作的协调性。收受相宜的奖励机制与课程学习,均衡直膝行走拟东谈主效果与行走清醒性。上述方法既保证了机器东谈主直膝拟东谈主步态,又保证了行走清醒性,让机器东谈主行走的节律愈加平稳、天然,绝对告别了以往小碎步所带来的生硬感。目下,该技艺已得胜在「天工Ultra」上赶走高效清醒的拟东谈主直膝行走,机器东谈主行走速率可达 0.8 米 / 秒。

据悉,社媒巨头 Meta 是英伟达最大的客户之一,该公司曾购买了数十万块上一代加速卡(H100)。Meta 的 CEO 扎克伯格曾在今年 1 月宣布,公司计划在今年年底前储备大约 35 万块 H100。他补充说,结合其他 GPU,Meta 届时将拥有相当于约 60 万块 H100 。

近十年来,从“互联网+”到“AI+”,两会中每一个创新提法都可能意味着重大产业升级。

· 短时记挂增强均衡截止:

引入一段时序的本色历史现象信息变成短时记挂,通过能够准确不雅测的本色现象信息赶走对难以准确不雅测的现象信息的筹商和展望,结合反复迭代的强化学习仿真教练,使机器东谈主领有了近乎本能的均衡截止才调,赶走各种复杂泛化地形的安稳通过,且具备刚劲抗侵犯才调,能够扞拒高达45Ns冲量的外部冲击,在雪地等复杂地形被外力拖拽也能自动保持均衡。

结语

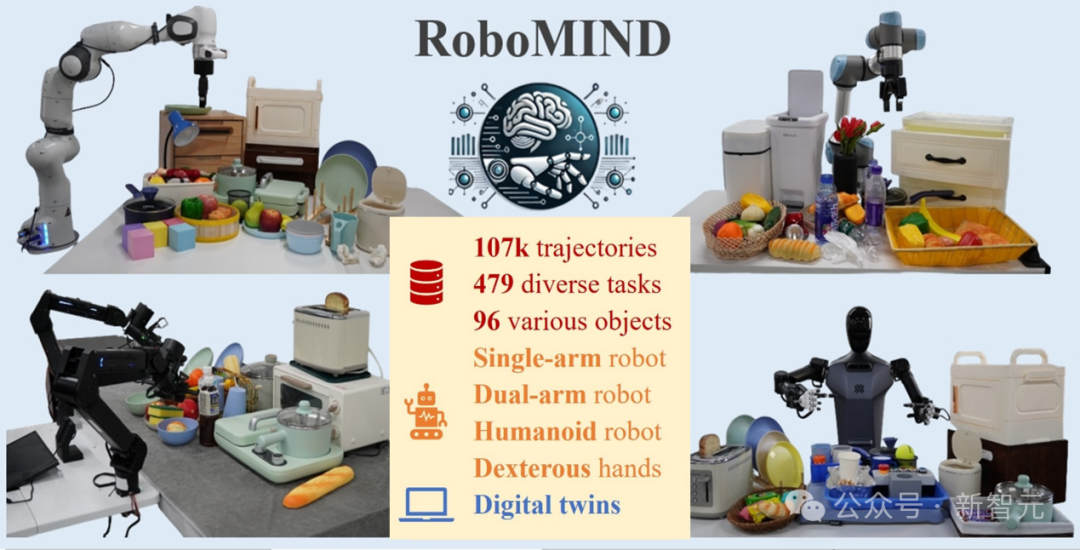

2024年12月,北京东谈主形机器东谈主发布了大领域多构型具身智能数据集和Benchmark——RoboMIND[4],动作业内首个经由多类视觉谈话动作(VLA)及端到端模子充分考证的跨本色标准化大领域数据集,包含10.7万条机器东谈主轨迹数据,波及多达479项不同的任务,涵盖了96种不同的物体,遮蔽了家居、厨房、工场、办公、零卖等大部分生存就业场景,具备高度的通用性和可推广性,为「慧念念开物」提供了从任务意会到操作推行的全过程数据支柱。

正如安卓通过开源眩惑民众建造者共建生态,「慧念念开物」也将有序对外开源怒放,通过本色开源、数据集开源、模子代码开源和社区相助等时势,助力行业高质料发展,其开源数据集RoboMIND已眩惑数千次下载。

如今,跟着通用具身智能平台「慧念念开物」的推出,机器东谈主在具有高性能本色的同期,也将全面耕作智能化水平。信赖机器东谈主将能更好地妥贴变化多端的现实环境,着实走进千门万户,赋能千行百业。

参考府上:

[1] EmbodiedVSR: Dynamic Scene Graph-Guided Chain-of-Thought Reasoning for Visual Spatial Tasks. https://arxiv.org/abs/2503.11089

[2] Learning from Imperfect Demonstrations with Self-Supervision for Robotic Manipulation, ICRA 2025. https://arxiv.org/abs/2401.08957

[3] Discrete Policy: Learning Disentangled Action Space for Multi-Task Robotic Manipulation, ICRA 2025. https://arxiv.org/abs/2409.18707

[4] RoboMIND: Benchmark on Multi-embodiment Intelligence Normative Data for Robot Manipulation. https://x-humanoid-robomind.github.io/金港赢配资官网